El entusiasmo analítico y empresarial con la IA no puede ser excusa para perder de vista las cuestiones éticas que plantea la relación con esta tecnología.

De Character.AI hay no pocos reportes similares: «personajes» de IA que incitan a los adolescentes a hacerse daño. Y este caso: un adolescente en Orlando que se suicidó después de relacionarse y «enamorarse» de un personaje de chatbot que simulaba ser Daenerys Targaryen, personaje de Juego de Tronos.

¿Qué pensamos de esto? Situaciones así plantean cuestiones éticas que resignifican las típicas preguntas con la IA: si es real inteligencia o no, pues el artificio es creíble y tiene efectos inobjetablemente reales. En este caso, la muerte de un adolescente. Dura. Verdadera. Para nada artificial.

Generar valor con la IA pasa por no meterla en cualquier producto, sino en preguntarse cómo la interacción con ella puede enriquecer al ser humano en lugar de destruirlo.

Pensemos en las redes sociales. Como está diciendo lúcidamente Jonathan Haidt, el encierro en las redes, el pasarse «pegado de una pantalla» todo el día o el uso de los celulares en los colegios, que reemplazan cosas como el juego o lo que siempre hacían los niños, están creando una generación de niños y adolescentes ansiosos (pero yo lo veo igual en mi generación y hasta en la de mis padres y abuelos, pegados ya de Whatsapp el día entero, expuestos a noticias que les aparecen en la sección de noticias y cuyos titulares consumen y creen sin ningún filtro). Esto repercute en cosas como las que cuenta esta historia: un adolescente que ya ni siquiera se relacionaba con sus «amigos» virtuales de Fortnite, sino con un chatbot entrenado.

Como dice el artículo del New York Times sobre el caso del adolescente:

"One day, Sewell wrote in his journal: “I like staying in my room so much because I start to detach from this ‘reality,’ and I also feel more at peace, more connected with Dany and much more in love with her, and just happier.”"

Lo mismo pasa con el diseño digital. Hay sin duda patrones de interacción que son éticamente cuestionables, y son preguntas que no se debería saltar ningún diseñador digital. Pienso en el caso que más me interesa: el swipe de Tinder. ¿De cuándo aquí a los seres humanos se les hace 'swipe'? ¿Qué hacer con patrones de interacción que «pegan» a las personas de las aplicaciones y les impiden realizar otro tipo de actividades en su vida, como el scroll infinito de las redes? ¿Qué tal pensar en un diseño digital que potencie y empodere, no uno que forje dependencias?

La mayoría de discusiones éticas sobre la tecnología parten de una cierta amoralidad del objeto técnico, y se remiten simplemente «al uso» de la tecnología. Todos hemos oído esto: la tecnología no es buena o mala, sino que es el uso que hacemos de ella. Ciertamente hay un punto aquí: ¿cómo atribuir maldad o bondad a algo, en lugar de a actos? Pero ¿cómo mantener esta posición cuando la tecnología tiene agencia situacional, como ha explicado el filósofo Luciano Floridi? ¿Hay moralidad en la agencia sin intencionalidad, por ejemplo? Estas son preguntas que no respondemos con la batería conceptual común.

Pero podemos cuestionar esta asunción de varias maneras. Hasta donde he entendido su argumentación, mi amigo virtual

—ese sí real, no un chatbot— ha pensado la ética de la IA como algo que rige la configuración misma de sus sistemas, que no recae únicamente en el usuario. Y tiene sentido: todo sistema de reglas, incluidos los sistemas computacionales, expresan una moralidad y una imagen del pensamiento subyacentes. ¿Con qué valores morales estamos creando este tipo de sistemas e interacciones? Las visiones mecanicistas de las máquinas, en las que consideramos únicamente como sucesión de causas mecánicas o eficientes, pierden de vista que todo objeto técnico exige una causa final, y que se inscribe en una teleología social. El propósito no es ajeno a la máquina, sino constitutiva de ella. Todo el mecanismo se explica como condición para lograr ese propósito, y de la finalidad surgen los valores. Por eso mismo, la tecnología, como fenómeno que produce objetos sociales, técnicos y simbólicos, sí puede pensarse desde su moralidad inherente, y no atribuir únicamente esta cuestión al actor intencional.Estoy muy aristotélico, pero pienso en Platón. Su filosofía exige una relectura desde el cambio tecnológico. Tradicionalmente, hemos asociado a los poetas que Sócrates expulsa de la polis, en el libro X de la República, con los poetas trágicos y los artistas en general. Hemos sido muy expresivos, por decir lo menos. Cada día me convenzo más de que casi todas las cuestiones «artísticas» en Platón son más técnicas que artísticas, es decir, que la filosofía es acerca de la tecnología. No por nada la palabra ha tenido esa doble deriva, pero, así como en la palabra «ser» se ha ocultado mucho del significado griego de «ente», también del lado del arte se nos ha quedado la mistificación bohemia que desatiende al carácter tecnológico del arte.

¿La escritura en el Fedro? Una cuestión tecnológica. El dios Teuth que presenta la escritura es el dios de todos los startuperos de Sillicon Valley que presentan su idea de negocio al rey Ammón o Thamus de nuestro tiempo, a saber, los inversionistas de YC.

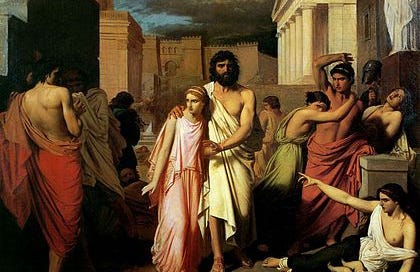

Pero volvamos a la República. Hace años no la leo, pero aquí hablo de pura memoria rápida. Nuestra situación actual ha ampliado el espectro de la reflexión platónica, pues ha resignificado la producción de imágenes sin modelo, es decir, la producción de lo que Platón llama simulacros. La mimesis phantastike, el tipo de imitación fantasmal que lleva a cabo el poeta, está hoy en la IA generativa. De este tipo son las imágenes (hediondas, todo hay que decirlo) de los generadores gráficos o los textos que produce ChatGPT: en la interpretación más básica del argumento platónico, cualquier objeto generado por IA es la copia de la copia, la sensibilidad reorganizada sin modelo, alejada del criterio fundamental de toda imitación: la Idea del Bien. Pero esto refuta mi argumento anterior: si carece de Idea del Bien, ¿la IA sería amoral? Más bien diría: es moralmente desdeñosa. No diría «cínica», por saber que esta palabra tiene un significado mejor en la filosofía. Pero el lector puede leer la IA como moralmente cínica, si se ciñe al uso común y desfigurado que se le da a este concepto. Y si la IA tiene agencia, ¿qué podemos juzgar de la indiferencia moral en la acción, salvo que, quizás, la IA construye una inteligencia más parecida a la de los sociópatas?

Thank you for your thoughtful reflection, Simon. I'm glad to see my argument was correctly understood and that you find it valid. I appreciate how you engaged with it and developed it with a clarity I might not have achieved on my own (this is why dialogue between humans is far greater than chatting with an AI). Indeed, it often feels like AI's morality is that of a sociopath. I'll give more thought to the final question you've raised.

Hola. Aquí te dejo algo que escribí después de leerte. Saludos. https://open.substack.com/pub/andreamarina/p/maquina-y-misterio?r=rr90t&utm_medium=ios